作者:Laura Spinney

译者:刘媛媛

原文:Are we witnessing the dawn of post-theory science?

让我们回忆一下,Isaac Newton 被一个苹果砸中头部,然后是怎么提出牛顿第二定律——万有引力的?

大概过程是这样的:大量的实验和数据分析之后,他意识到,力、质量和加速度之间存在根本的关系。然后他制定了一种理论来描述这种关系,表示为一个方程“F=ma”,并用它来预测苹果以外的物体的行为。事实证明,他的预测是正确的(这对于不要求精确度的人们来说是足够)。

现在,我们再来对比一下当今科学发展的新潮流:Facebook 的机器学习工具比任何心理学家都更能预测你的偏好;DeepMind 开发的 AlphaFold,可以根据蛋白质所含的氨基酸对蛋白质结构做出了迄今为止最准确的预测。

它们的诞生对于科学界的研究范式来说究竟意味着什么?换句话说:获取知识的最佳方式是什么?科学又从何而来?

人类的不安

Facebook 和 AlphaFold 没有提供任何理论解释。这些算法只是完成工作并且效果还不错。我们每天都在见证 Facebook 预测的社会影响。AlphaFold 的影响尚未显现,但许多人相信它将改变医学。

一时间,它们的理论基础似乎隐居二线。

2008 年,时任 Wired 杂志的主编 Chris Anderson 预言了一种理论的消亡。他认为,现在已经积累了如此多的数据,而计算机在发现数据间的关系方面比人类表现的更好。很快,古老的科学方法,即假设、预测、检验,将被扔进历史的垃圾箱。人们不再寻找事物的本质原因,而是满足于数据间的相关性。

事后看来,Anderson 所看到的情况是真实的。大量数据的复杂性无法被我们传统理解的理论所捕捉。

德国马克斯普朗克生物控制论研究所所长、计算神经科学家 Peter Dayan 说:“因为不知道它们会是什么样子的,所以我们甚至没有能力写出对描述有用的理论。”

但 Anderson 对理论终结的预测似乎为时过早。尽管 Facebook 和 AlphaFold 这样的无理论基础的预测引擎取得了成功,但理论不会消亡,此处有以下三个原因。

第一个原因是,我们已经意识到 AI,尤其是神经网络这种机器学习形式,无需接受明确的指令即可从数据中学习,它们本身是容易出错的。想想谷歌搜索引擎和亚马逊招聘工具中记录的偏见就可以明白。

第二,人类对没有理论基础的科学方法深感不安。我们就是不喜欢和黑匣子相处。

第三,可能仍然有很多传统类型的理论(即人类可以理解的)可以有效地解释很多事情,只是尚未被发现。

所以理论还没有消亡,但它正在改变——也许还会变得面目全非。普林斯顿大学心理学家 Tom Griffiths 说:“拥有大量数据时的有意义的理论,与仅拥有少量数据时有意义的理论,看起来是完全不同。”

Griffiths 一直在使用神经网络来帮助改进他所在领域的现有理论,即人类决策。一个关于人们在涉及经济风险时如何做出决策的流行理论是前景理论,它由行为经济学家 Daniel Kahneman 和 Amos Tversky 在 1970 年代提出的(后来 Kahneman 获得了诺贝尔奖)。其核心理念是:人并非总是理性的。

图2 Daniel Kahneman,人类行为前景理论的创始人之一

在 2021 年 6 月的 Science杂志上,Griffiths 的小组描述了他们如何在一个庞大的决策数据集上,训练一个神经网络模型,该数据集包含在 10,000 个有风险的选择场景中人们做出的决策,然后比较模型预测有关前景理论的进一步决策的准确度。他们发现前景理论做得很好,但是神经网络在突出理论失败的地方(即预测失败的地方)显示出它的价值(参见“数据实战派”往期报道)。

Griffiths 认为,这些反例反映的信息量更大,因为它们揭示了现实生活中存在的更多复杂性。例如,正如前景理论所描述的那样,人类不断地根据传入的信息权衡概率。但是,当大脑要计算的竞争概率太多时,他们可能会转向不同的策略。例如,受经验法则的指导,股****经纪人的经验法则,可能与青少年比特币交易员的经验法则不同,因为它来自不同的经验。

“我们基本上是在使用机器学习系统,来识别那些观察与理论不一致的情况”,Griffiths 说。

数据集越大,人工智能学习的不一致就越多。最终得到的结果,不是传统意义上的关于人们如何做出决定的精确主张的理论,而是一组受某些约束的主张。

一种描绘它的方式可能是“如果...那么...”类型规则的分支树,这很难用数学来描述,更不用说用语言描述了。

可理解和预测性之间的权衡

人类也不是第一次面临这种局面了。

1980 年代,语音识别软件先驱 Frederick Jelinek 曾说说:每解雇一名团队中的语言学家,语音识别器的性能就能获得提高。

他的意思是,对理论的执着某种程度上阻碍了实践上的进步。

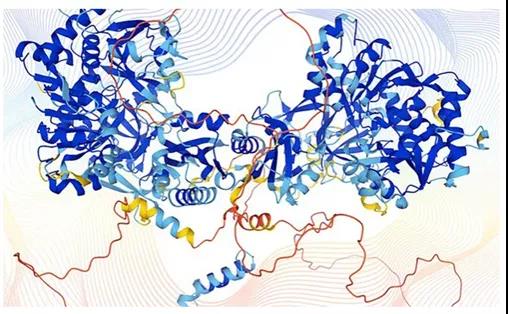

以预测而蛋白质结构的例子来说明。蛋白质的功能很大程度上取决于它的结构,因此,如果你想设计一种****物来阻断或增强给定蛋白质的作用,你需要了解它的结构。

AlphaFold 使用 X 射线晶体学等技术,对实验推导的结构进行了训练,目前它对于有一些实验数据的蛋白质的预测,比那些没有实验数据的蛋白质的预测更可靠。

欧洲生物信息学研究所 (EMBL-EBI) 前主任 Janet Thornton 说:”模型的可靠性是一直在提高的。缺少理论并不会阻止****物设计师使用它,这只会增进我们对生命和治疗的理解。”

图3 由 AlphaFold 程序模拟的蛋白质结构

同时,也有一部分人显然对这种科学发展方向不太满意。

例如,批评者指出,神经网络可能会产生虚假的相关性,尤其是在训练数据集很小的情况下。

而且所有数据集都是有偏见的,毕竟科学家们收集数据的方式不是均匀或中立的,而是始终考虑某些假设,这些假设对谷歌和亚马逊的人工智能造成了破坏性影响。

正如科学哲学家 Sabina Leonelli 解释的那样:“我们使用的数据环境非常扭曲。”

虽然这些问题确实存在,但计算神经科学家Dayan并不认为它们是不可克服的。

他指出,人类也有偏见,而且与人工智能不同,人类是以非常难以审视或纠正的方式。

AI 新科学面临的一个更大的障碍,可能是人类需要解释这个世界——用因果关系来讨论。

2019 年,西雅图华盛顿大学的神经科学家 Bingni Brunton 和 Michael Beyeler 写道:“这种对可解释性的需求,可能阻碍了科学家们对大脑产生新的见解,这种见解只能从大型数据集中出现”。

但他们对此也表示同情。他们说:“如果要将这些见解转化为****物和设备等有用的东西,计算模型必须产生对临床医生、最终用户和行业可解释和信任的洞察力。”

解决如何弥合可解释性差距的——可解释人工智能,已成为热门话题。但这种差距只会越来越大,我们可能会面临权衡取舍:愿意为可解释性放弃多少可预测性?

对 AI 驱动的科学,还有最后一个反对意见是,人们对旧理论方法仍有待发现,其中可能存在有用的地方(即从离散示例中提取的概括)。而且只有人类才能做到这一点,因为它需要直觉。

换句话说,它需要一种对一般规则相关的示例属性,进行本能的归纳总结。

牛顿厉害的一点,他为了提出牛顿第二定律,必须忽略一些数据。例如,他必须想象,事物在真空中下落,不受空气阻力的干扰。

上个月 Nature 发了一篇文章,德国数学家 Christian Stump 在文中表示,人类这种直觉行为是“发明/发现过程的核心”。但他写这篇文章的原因是,DeepMind 建立了一个机器学习程序,该程序帮助人类数学家从以往的数学中获得新的见解与概括。

因此,可以预见的是,2022 年,AI 会在各种科学过程中留下足迹。

我们越将它纳入人类对知识的追求,它就越会改变这种追求。

我们必须学会忍受这一点,并向自己保证这样一件事:人类仍然在问问题,正如 Pablo Picasso 在 1960 年代所说,“计算机是无用的。他们只能给人类答案。”

*博客内容为网友个人发布,仅代表博主个人观点,如有侵权请联系工作人员删除。