2.4 平稳发展期:20世纪90年代—2010年

由于互联网技术的迅速发展,加速了人工智能的创新研究,促使人工智能技术进一步走向实用化,人工智能相关的各个领域都取得长足进步。在2000年代初,由于专家系统的项目都需要编码太多的显式规则,这降低了效率并增加了成本,人工智能研究的重心从基于知识系统转向了机器学习方向。

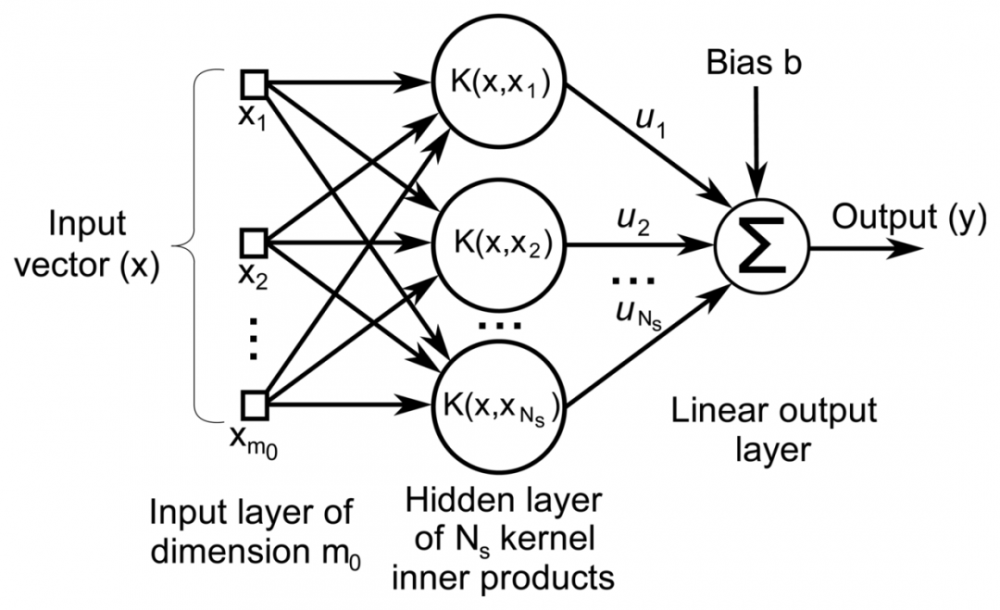

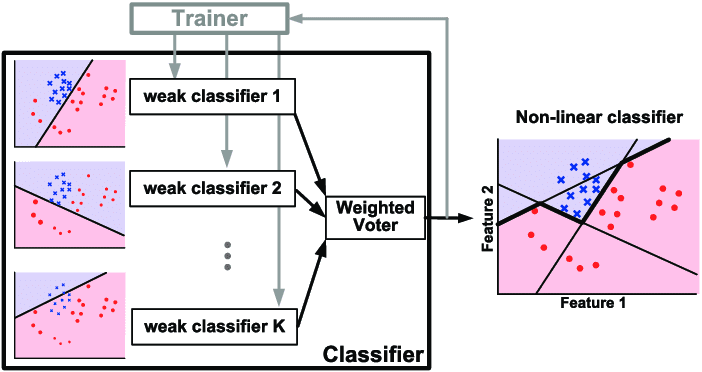

1995年,Cortes和Vapnik提出联结主义经典的支持向量机(Support Vector Machine),它在解决小样本、非线性及高维模式识别中表现出许多特有的优势,并能够推广应用到函数拟合等其他机器学习问题中。

支持向量机(Support Vector Machine, SVM)可以视为在感知机基础上的改进,是建立在统计学习理论的VC维理论和结构风险最小原理基础上的广义线性分类器。与感知机主要差异在于:1、感知机目标是找到一个超平面将各样本尽可能分离正确(有无数个),SVM目标是找到一个超平面不仅将各样本尽可能分离正确,还要使各样本离超平面距离最远(只有一个最大边距超平面),SVM的泛化能力更强。2、对于线性不可分的问题,不同于感知机的增加非线性隐藏层,SVM利用核函数,本质上都是实现特征空间非线性变换,使可以被线性分类。

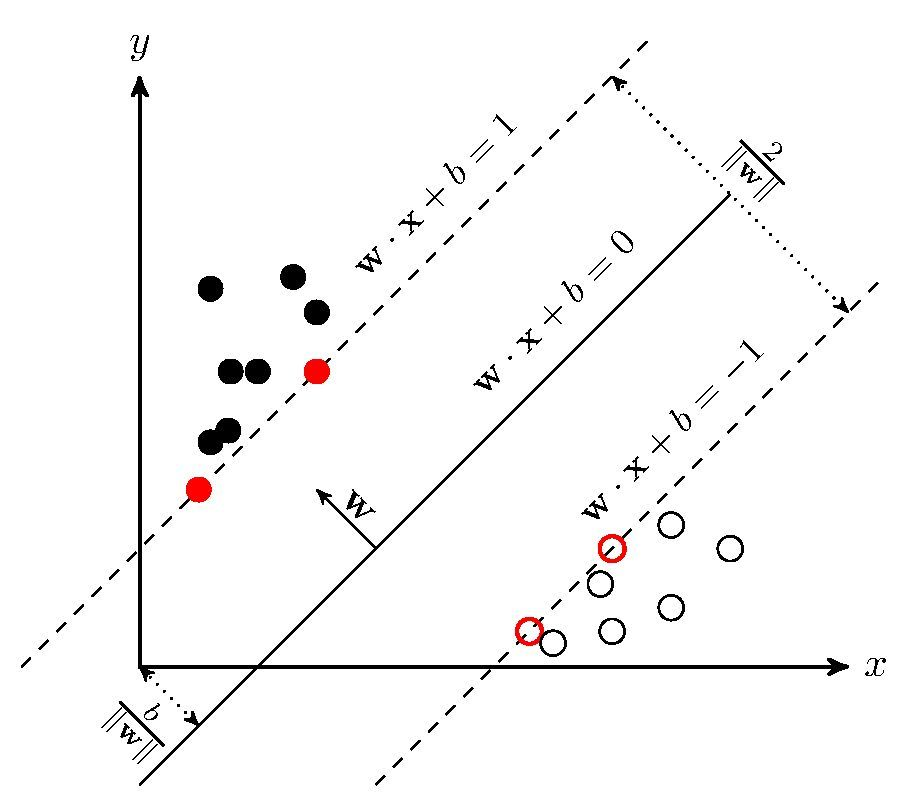

1995年, Freund和schapire提出了 AdaBoost (Adaptive Boosting)算法。AdaBoost采用的是Boosting集成学习方法——串行组合弱学习器以达到更好的泛化性能。另外一种重要集成方法是以随机森林为代表的Bagging并行组合的方式。以“偏差-方差分解”分析,Boosting方法主要优化偏差,Bagging主要优化方差。

Adaboost迭代算法基本思想主要是通过调节的每一轮各训练样本的权重(错误分类的样本权重更高),串行训练出不同分类器。最终以各分类器的准确率作为其组合的权重,一起加权组合成强分类器。

1997年国际商业机器公司(简称IBM)深蓝超级计算机战胜了国际象棋世界冠军卡斯帕罗夫。深蓝是基于暴力穷举实现国际象棋领域的智能,通过生成所有可能的走法,然后执行尽可能深的搜索,并不断对局面进行评估,尝试找出最佳走法。

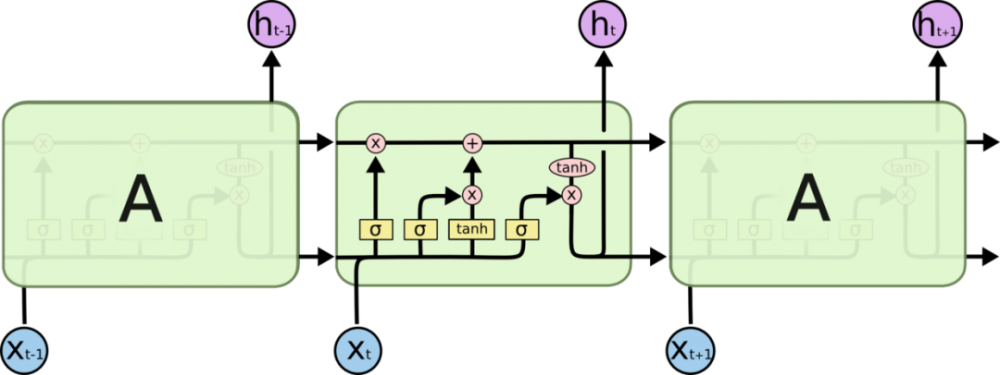

1997年,Sepp Hochreiter 和 Jürgen Schmidhuber提出了长短期记忆神经网络(LSTM)。

LSTM是一种复杂结构的循环神经网络(RNN),结构上引入了遗忘门、输入门及输出门:输入门决定当前时刻网络的输入数据有多少需要保存到单元状态,遗忘门决定上一时刻的单元状态有多少需要保留到当前时刻,输出门控制当前单元状态有多少需要输出到当前的输出值。这样的结构设计可以解决长序列训练过程中的梯度消失问题。

1998年,万维网联盟的蒂姆·伯纳斯·李(Tim Berners-Lee)提出语义网(Semantic Web)的概念。其核心思想是:通过给万维网上的文档(如HTML)添加能够被计算机所理解的语义(Meta data),从而使整个互联网成为一个基于语义链接的通用信息交换媒介。换言之,就是构建一个能够实现人与电脑无障碍沟通的智能网络。

2001年,John Lafferty首次提出条件随机场模型(Conditional random field,CRF)。CRF是基于贝叶斯理论框架的判别式概率图模型,在给定条件随机场P ( Y ∣ X ) 和输入序列x,求条件概率最大的输出序列y *。在许多自然语言处理任务中比如分词、命名实体识别等表现尤为出色。

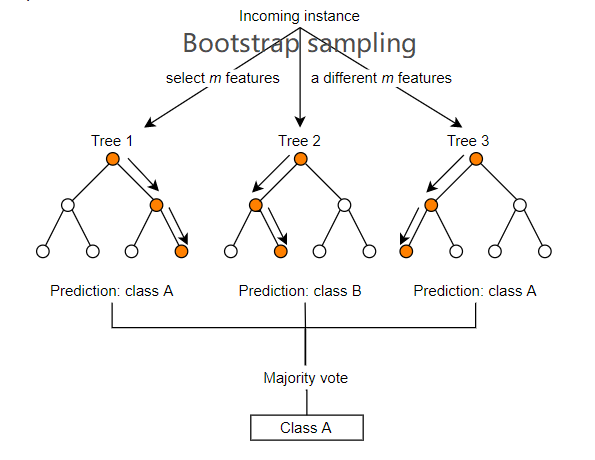

2001年,布雷曼博士提出随机森林(Random Forest)。随机森林是将多个有差异的弱学习器(决策树)Bagging并行组合,通过建立多个的拟合较好且有差异模型去组合决策,以优化泛化性能的一种集成学习方法。多样差异性可减少对某些特征噪声的依赖,降低方差(过拟合),组合决策可消除些学习器间的偏差。

随机森林算法的基本思路是对于每一弱学习器(决策树)有放回的抽样构造其训练集,并随机抽取其可用特征子集,即以训练样本及特征空间的多样性训练出N个不同的弱学习器,最终结合N个弱学习器的预测(类别或者回归预测数值),取最多数类别或平均值作为最终结果。

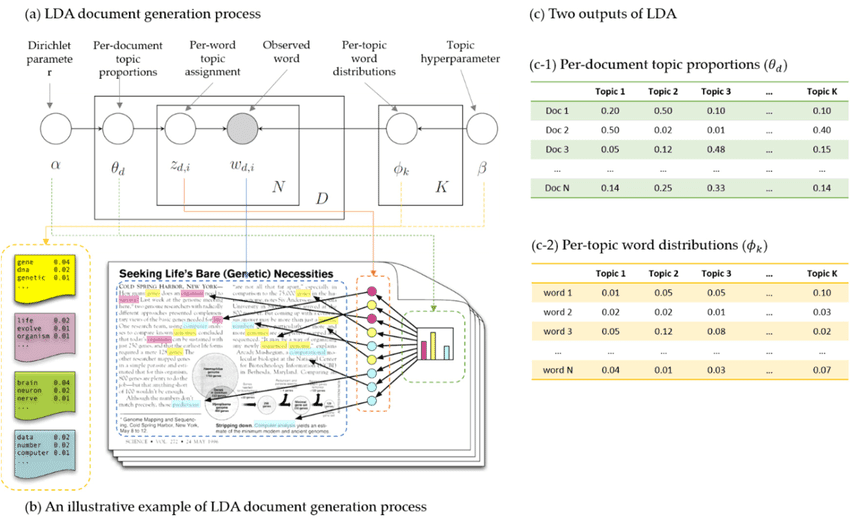

2003年,David Blei, Andrew Ng和 Michael I. Jordan于2003年提出LDA(Latent Dirichlet Allocation)。

LDA是一种无监督方法,用来推测文档的主题分布,将文档集中每篇文档的主题以概率分布的形式给出,可以根据主题分布进行主题聚类或文本分类。

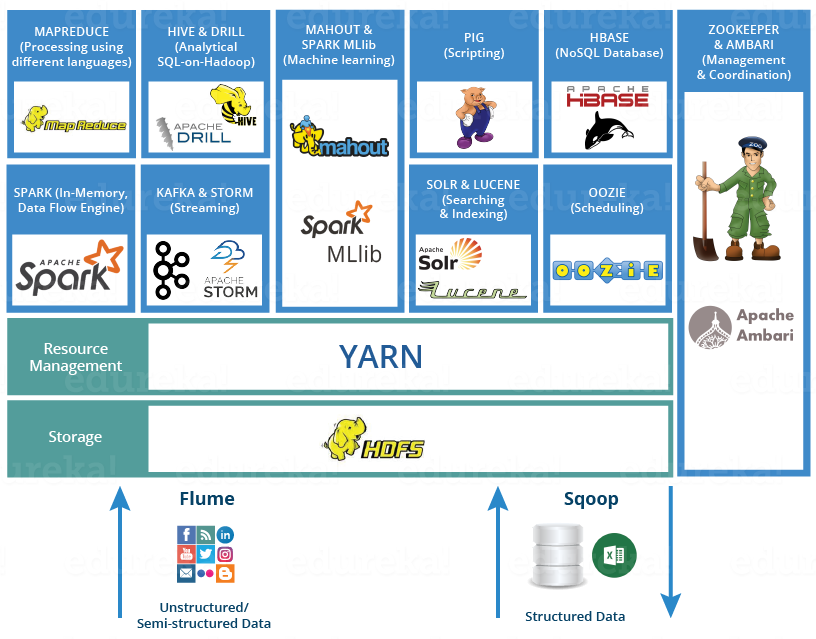

2003年,Google公布了3篇大数据奠基性论文,为大数据存储及分布式处理的核心问题提供了思路:非结构化文件分布式存储(GFS)、分布式计算(MapReduce)及结构化数据存储(BigTable),并奠定了现代大数据技术的理论基础。

2005 年,波士顿动力公司推出一款动力平衡四足机器狗,有较强的通用性,可适应较复杂的地形。

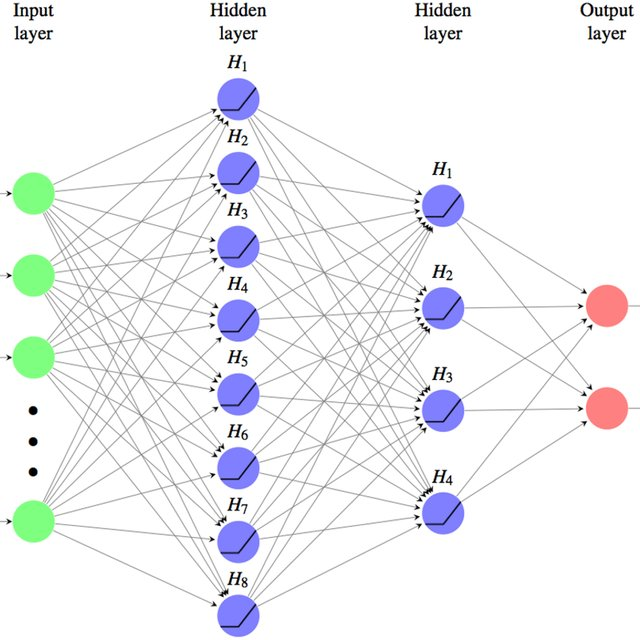

2006年,杰弗里·辛顿以及他的学生鲁斯兰·萨拉赫丁诺夫正式提出了深度学习的概念(Deeping Learning),开启了深度学习在学术界和工业界的浪潮。2006年也被称为深度学习元年,杰弗里·辛顿也因此被称为深度学习之父。

深度学习的概念源于人工神经网络的研究,它的本质是使用多个隐藏层网络结构,通过大量的向量计算,学习数据内在信息的高阶表示。

2010年,Sinno Jialin Pan和 Qiang Yang发表文章《迁移学习的调查》。

迁移学习(transfer learning)通俗来讲,就是运用已有的知识(如训练好的网络权重)来学习新的知识以适应特定目标任务,核心是找到已有知识和新知识之间的相似性。

2.5 蓬勃发展期:2011年至今

随着大数据、云计算、互联网、物联网等信息技术的发展,泛在感知数据和图形处理器等计算平台推动以深度神经网络为代表的人工智能技术飞速发展,大幅跨越了科学与应用之间的技术鸿沟,诸如图像分类、语音识别、知识问答、人机对弈、无人驾驶等人工智能技术实现了重大的技术突破,迎来爆发式增长的新高潮。

2011年,IBM Watson问答机器人参与Jeopardy回答测验比赛最终赢得了冠军。Waston是一个集自然语言处理、知识表示、自动推理及机器学习等技术实现的电脑问答(Q&A)系统。

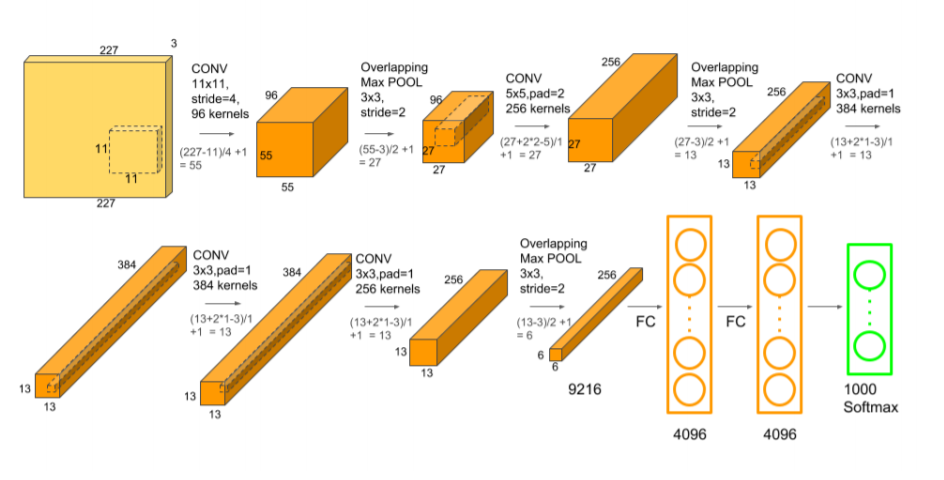

2012年,Hinton和他的学生Alex Krizhevsky设计的AlexNet神经网络模型在ImageNet竞赛大获全胜,这是史上第一次有模型在 ImageNet 数据集表现如此出色,并引爆了神经网络的研究热情。

AlexNet是一个经典的CNN模型,在数据、算法及算力层面均有较大改进,创新地应用了Data Augmentation、ReLU、Dropout和LRN等方法,并使用GPU加速网络训练。

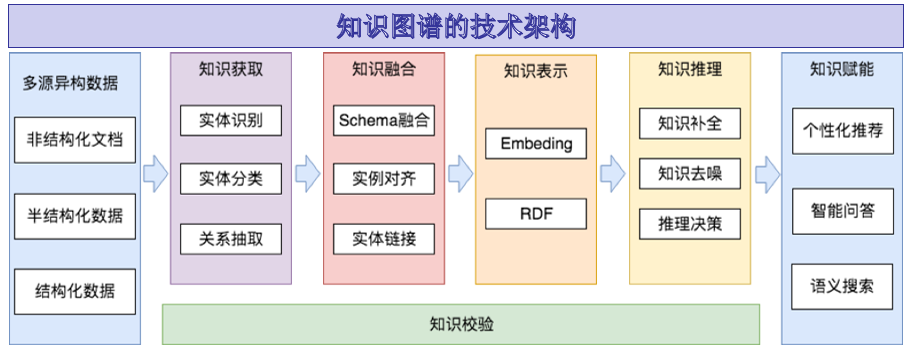

2012年,谷歌正式发布谷歌知识图谱Google Knowledge Graph),它是Google的一个从多种信息来源汇集的知识库,通过Knowledge Graph来在普通的字串搜索上叠一层相互之间的关系,协助使用者更快找到所需的资料的同时,也可以知识为基础的搜索更近一步,以提高Google搜索的质量。

知识图谱是结构化的语义知识库,是符号主义思想的代表方法,用于以符号形式描述物理世界中的概念及其相互关系。其通用的组成单位是RDF三元组(实体-关系-实体),实体间通过关系相互联结,构成网状的知识结构。

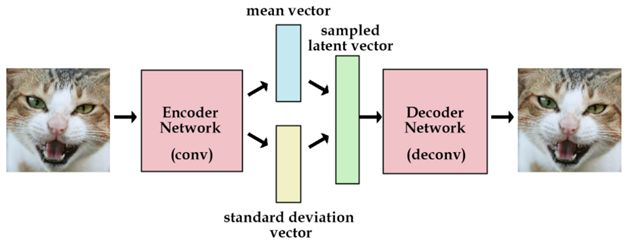

2013年,Durk Kingma和Max Welling在ICLR上以文章《Auto-Encoding Variational Bayes》提出变分自编码器(Variational Auto-Encoder,VAE)。

VAE基本思路是将真实样本通过编码器网络变换成一个理想的数据分布,然后把数据分布再传递给****网络,构造出生成样本,模型训练学习的过程是使生成样本与真实样本足够接近。

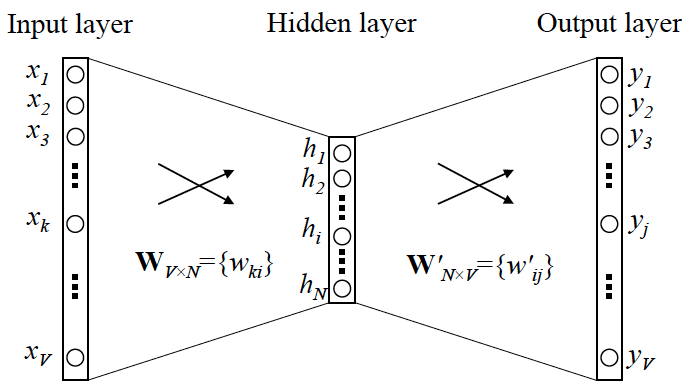

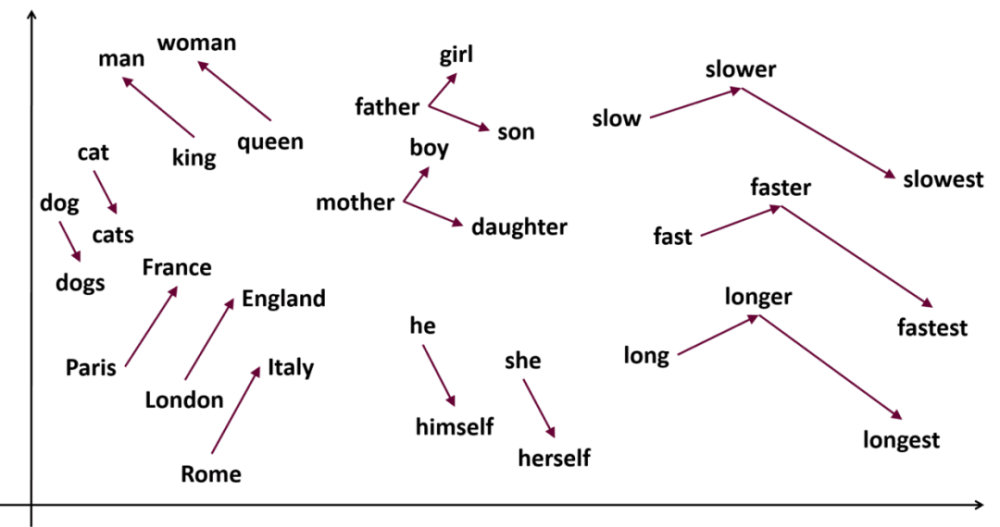

2013年,Google的Tomas Mikolov 在《Efficient Estimation of Word Representation in Vector Space》提出经典的 Word2Vec模型用来学习单词分布式表示,因其简单高效引起了工业界和学术界极大的关注。

Word2Vec基本的思想是学习每个单词与邻近词的关系,从而将单词表示成低维稠密向量。通过这样的分布式表示可以学习到单词的语义信息,直观来看,语义相似的单词的距离相近。

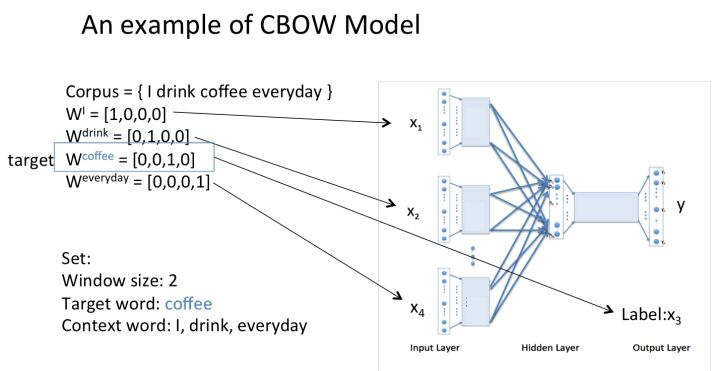

Word2Vec网络结构是一个浅层神经网络(输入层-线性全连接隐藏层->输出层),按训练学习方式可分为CBOW模型(以一个词语作为输入,来预测它的邻近词)或Skip-gram模型 (以一个词语的邻近词作为输入,来预测这个词语)。

2014年,聊天程序“尤金·古斯特曼”(Eugene Goostman)在英国皇家学会举行的“2014图灵测试”大会上,首次“通过”了图灵测试。

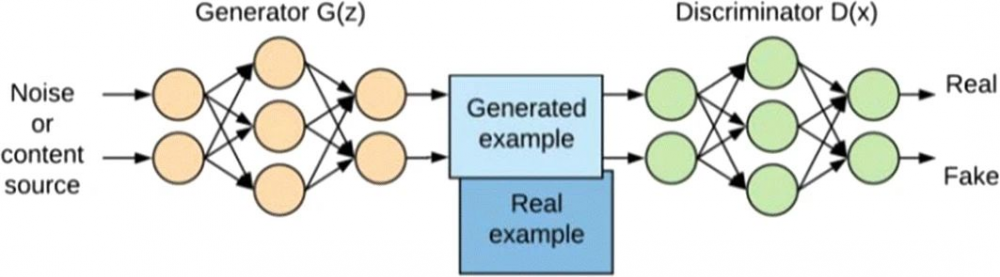

2014年,Goodfellow及Bengio等人提出生成对抗网络(Generative Adversarial Network,GAN),被誉为近年来最酷炫的神经网络。

GAN是基于强化学习(RL)思路设计的,由生成网络(Generator, G)和判别网络(Discriminator, D)两部分组成, 生成网络构成一个映射函数G: Z→X(输入噪声z, 输出生成的伪造数据x), 判别网络判别输入是来自真实数据还是生成网络生成的数据。在这样训练的博弈过程中,提高两个模型的生成能力和判别能力。

2015年,为纪念人工智能概念提出60周年,深度学习三巨头LeCun、Bengio和Hinton(他们于2018年共同获得了图灵奖)推出了深度学习的联合综述《Deep learning》。

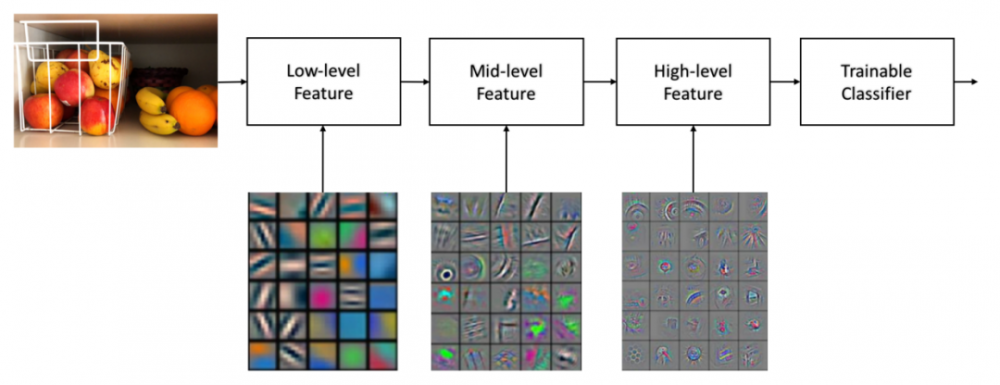

《Deep learning》文中指出深度学习就是一种特征学习方法,把原始数据通过一些简单的但是非线性的模型转变成为更高层次及抽象的表达,能够强化输入数据的区分能力。通过足够多的转换的组合,非常复杂的函数也可以被学习。

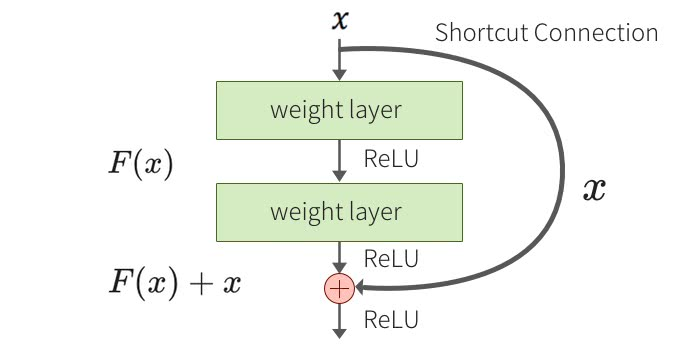

2015年,Microsoft Research的Kaiming He等人提出的残差网络(ResNet)在ImageNet大规模视觉识别竞赛中获得了图像分类和物体识别的优胜。

残差网络的主要贡献是发现了网络不恒等变换导致的“退化现象(Degradation)”,并针对退化现象引入了 “快捷连接(Shortcut connection)”,缓解了在深度神经网络中增加深度带来的梯度消失问题。

2015年,谷歌开源TensorFlow框架。它是一个基于数据流编程(dataflow programming)的符号数学系统,被广泛应用于各类机器学习(machine learning)算法的编程实现,其前身是谷歌的神经网络算法库DistBelief。

2015年,马斯克等人共同创建OpenAI。它是一个非营利的研究组织,使命是确保通用人工智能 (即一种高度自主且在大多数具有经济价值的工作上超越人类的系统)将为全人类带来福祉。其发布热门产品的如:OpenAI Gym,GPT等。

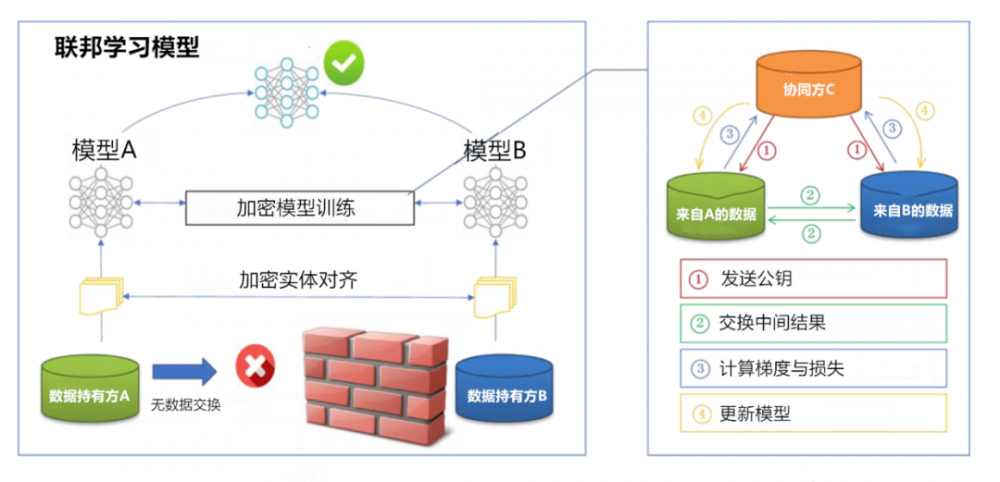

2016年,谷歌提出联邦学习方法,它在多个持有本地数据样本的分散式边缘设备或服务器上训练算法,而不交换其数据样本。

联邦学习保护隐私方面最重要的三大技术分别是:差分隐私 ( Differential Privacy )、同态加密 ( Homomorphic Encryption )和 隐私保护集合交集 ( Private Set Intersection ),能够使多个参与者在不共享数据的情况下建立一个共同的、强大的机器学习模型,从而解决数据隐私、数据安全、数据访问权限和异构数据的访问等关键问题。

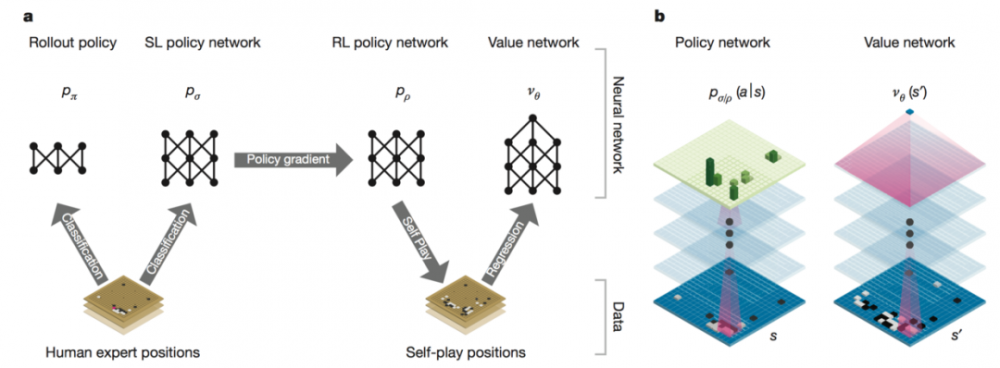

2016年,AlphaGo与围棋世界冠军、职业九段棋手李世石进行围棋人机大战,以4比1的总比分获胜。

AlphaGo是一款围棋人工智能程序,其主要工作原理是“深度学习”,由以下四个主要部分组成:策略网络(Policy Network)给定当前局面,预测并采样下一步的走棋;快速走子(Fast rollout)目标和策略网络一样,但在适当牺牲走棋质量的条件下,速度要比策略网络快1000倍;价值网络(Value Network)估算当前局面的胜率;蒙特卡洛树搜索(Monte Carlo Tree Search)树搜索估算每一种走法的胜率。

在2017年更新的AlphaGo Zero,在此前的版本的基础上,结合了强化学习进行了自我训练。它在下棋和游戏前完全不知道游戏规则,完全是通过自己的试验和摸索,洞悉棋局和游戏的规则,形成自己的决策。随着自我博弈的增加,神经网络逐渐调整,提升下法胜率。更为厉害的是,随着训练的深入,AlphaGo Zero还独立发现了游戏规则,并走出了新策略,为围棋这项古老游戏带来了新的见解。

2017年,中国香港的汉森机器人技术公司(Hanson Robotics)开发的类人机器人索菲亚,是历史上首个获得公民身份的一台机器人。索菲亚看起来就像人类女性,拥有橡胶皮肤,能够表现出超过62种自然的面部表情。其“大脑”中的算法能够理解语言、识别面部,并与人进行互动。

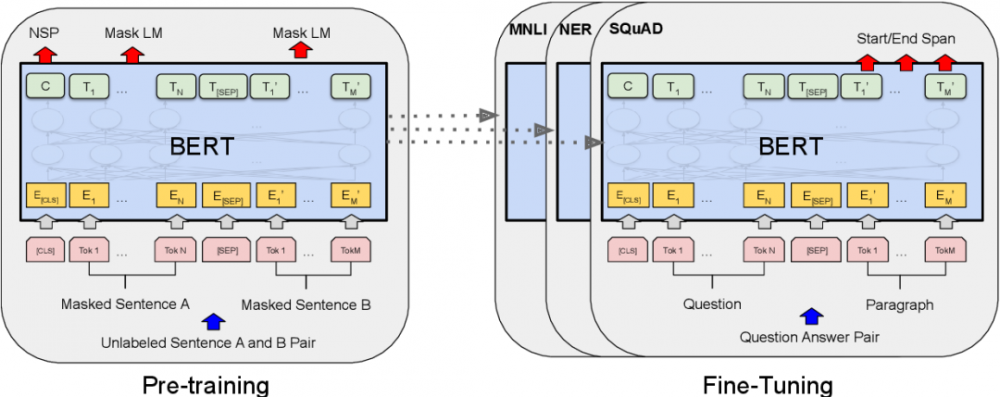

2018年,Google提出论文《Pre-training of Deep Bidirectional Transformers for Language Understanding》并发布Bert(Bidirectional Encoder Representation from Transformers)模型,成功在 11 项 NLP 任务中取得 state of the art 的结果。

BERT是一个预训练的语言表征模型,可在海量的语料上用无监督学习方法学习单词的动态特征表示。它基于Transformer注意力机制的模型,对比RNN可以更加高效、能捕捉更长距离的依赖信息,且不再像以往一样采用传统的单向语言模型或者把两个单向语言模型进行浅层拼接的方法进行预训练,而是采用新的masked language model(MLM),以致能生成深度的双向语言表征。

2019年, IBM宣布推出Q System One,它是世界上第一个专为科学和商业用途设计的集成通用近似量子计算系统。

2019年,香港 Insilico Medicine 公司和多伦多大学的研究团队实现了重大实验突破,通过深度学习和生成模型相关的技术发现了几种候选****物,证明了 AI 发现分子策略的有效性,很大程度解决了传统新****开发在分子鉴定困难且耗时的问题。

2020年,Google与Facebook分别提出SimCLR与MoCo两个无监督学习算法,均能够在无标注数据上学习图像数据表征。两个算法背后的框架都是对比学习(contrastive learning),对比学习的核心训练信号是图片的“可区分性”。

2020年,OpenAI开发的文字生成 (text generation) 人工智能GPT-3,它具有1,750亿个参数的自然语言深度学习模型,比以前的版本GPT-2高100倍,该模型经过了将近0.5万亿个单词的预训练,可以在多个NLP任务(答题、翻译、写文章)基准上达到最先进的性能。

2020年,马斯克的脑机接口(brain–computer interface, BCI)公司Neuralink举行现场直播,展示了植入Neuralink设备的实验猪的脑部活动。

2020年,谷歌旗下DeepMind的AlphaFold2人工智能系统有力地解决了蛋白质结构预测的里程碑式问题。它在国际蛋白质结构预测竞赛(CASP)上击败了其余的参会选手,精确预测了蛋白质的三维结构,准确性可与冷冻电子显微镜(cryo-EM)、核磁共振或 X 射线晶体学等实验技术相媲美。

2020年,中国科学技术大学潘建伟等人成功构建76个光子的量子计算原型机“九章”,求解数学算法“高斯玻色取样”只需200秒,而目前世界最快的超级计算机要用6亿年。

2021年,OpenAI提出两个连接文本与图像的神经网络:DALL·E 和 CLIP。DALL·E 可以基于文本直接生成图像,CLIP 则能够完成图像与文本类别的匹配。

2021年,德国Eleuther人工智能公司于今年3月下旬推出开源的文本AI模型GPT-Neo。对比GPT-3的差异在于它是开源免费的。

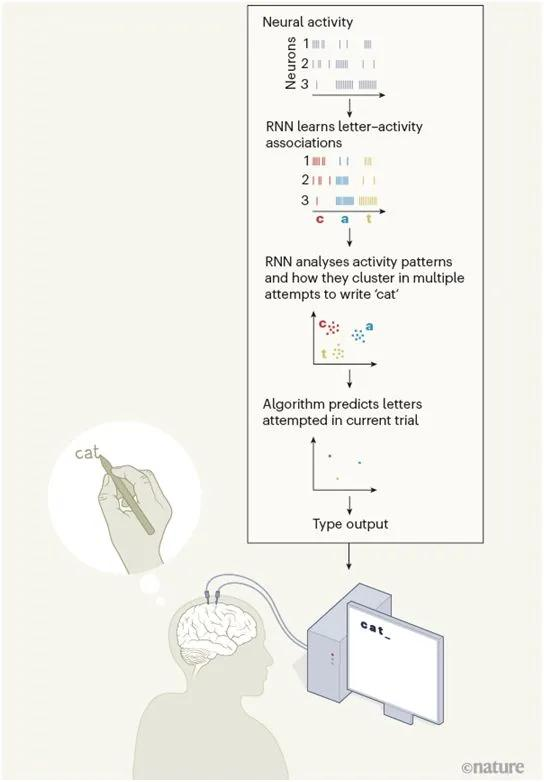

2021年,美国斯坦福大学的研究人员开发出一种用于打字的脑机接口(brain–computer interface, BCI),这套系统可以从运动皮层的神经活动中解码瘫痪患者想象中的手写动作,并利用递归神经网络(RNN)解码方法将这些手写动作实时转换为文本。相关研究结果发表在2021年5月13日的Nature期刊上,论文标题为“High-performance brain-to-text communication via handwriting”。

AI 未来趋势

人工智能有三个要素:数据、算力及算法,数据即是知识原料,算力及算法提供“计算智能”以学习知识并实现特定目标。

人工智能60多年的技术发展,可以归根为数据、算力及算法层面的发展,那么在可以预见的未来,人工智能发展将会出现怎样的趋势呢?

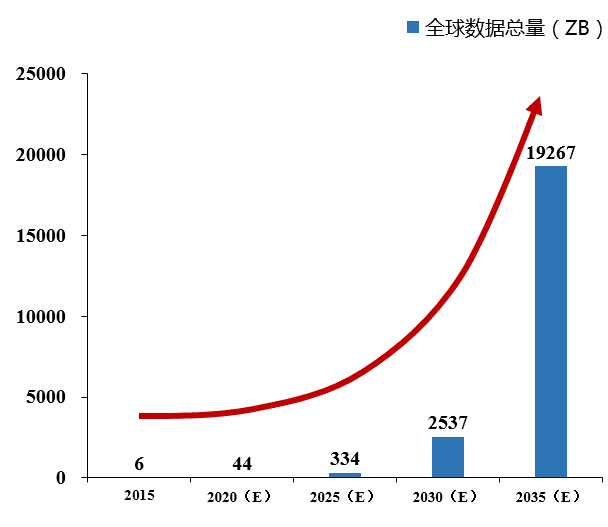

3.1 数据层面

数据是现实世界映射构建虚拟世界的基本要素,随着数据量以指数形式增长,开拓的虚拟世界的疆土也不断扩张。不同于AI算法开源,关键数据往往是不开放的,数据隐私化、私域化是一种趋势,数据之于AI应用,如同流量是互联网的护城河,有核心数据才有关键的AI能力。

3.2 算力层面

推理就是计算(reason is nothing but reckoning) --托马斯.霍布斯

计算是AI的关键,自2010年代以来的深度学习浪潮,很大程度上归功于计算能力的进步。

量子计算发展

在计算芯片按摩尔定律发展越发失效的今天,计算能力进步的放慢会限制未来的AI技,量子计算提供了一条新量级的增强计算能力的思路。随着量子计算机的量子比特数量以指数形式增长,而它的计算能力是量子比特数量的指数级,这个增长速度将远远大于数据量的增长,为数据爆发时代的人工智能带来了强大的硬件基础。

边缘计算发展

边缘计算作为云计算的一种补充和优化,一部分的人工智能正在加快速度从云端走向边缘,进入到越来越小的物联网设备中。而这些物联网设备往往体积很小,为此轻量机器学习(TinyML)受到青睐,以满足功耗、延时以及精度等问题。

类脑计算发展

以类脑计算芯片为核心的各种类脑计算系统,在处理某些智能问题以及低功耗智能计算方面正逐步展露出优势。类脑计算芯片设计将从现有处理器的设计方法论及其发展历史中汲取灵感,在计算完备性理论基础上结合应用需求实现完备的硬件功能。同时类脑计算基础软件将整合已有类脑计算编程语言与框架,实现类脑计算系统从“专用”向“通用”的逐步演进。

人工智能计算中心成为智能化时代的关键基础设施

人工智能计算中心基于最新人工智能理论,采用领先的人工智能计算架构,是融合公共算力服务、数据开放共享、智能生态建设、产业创新聚集的“四位一体”综合平台,可提供算力、数据和算法等人工智能全栈能力,是人工智能快速发展和应用所依托的新型算力基础设施。未来,随着智能化社会的不断发展,人工智能计算中心将成为关键的信息基础设施,推动数字经济与传统产业深度融合,加速产业转型升级,促进经济高质量发展。

3.3 算法层面

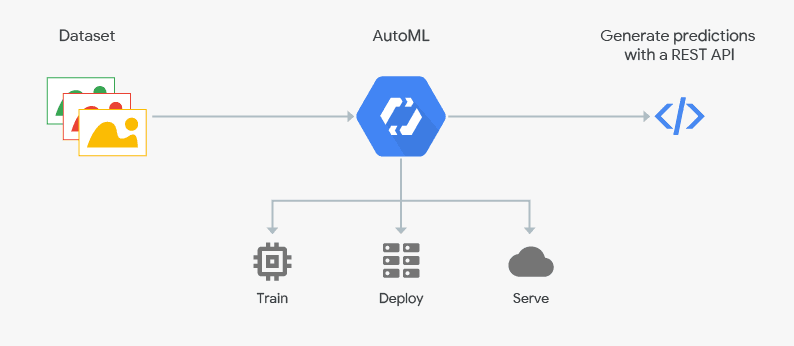

机器学习自动化(AutoML)发展

自动化机器学习(AutoML)解决的核心问题是:在给定数据集上使用哪种机器学习算法、是否以及如何预处理其特征以及如何设置所有超参数。随着机器学习在许多应用领域取得了长足的进步,这促成了对机器学习系统的不断增长的需求,并希望机器学习应用可以自动化构建并使用。借助AutoMl、MLOps技术,将大大减少机器学习人工训练及部署过程,技术人员可以专注于核心解决方案。

向分布式隐私保护方向演进

当前全球多个国家和地区已出台数据监管法规,如HIPAA(美国健康保险便利和责任法案)、GDPR(欧盟通用数据保护条例)等,通过严格的法规限制多机构间隐私数据的交互。分布式隐私保护机器学习(联邦学习)通过加密、分布式存储等方式保护机器学习模型训练的输入数据,是打破数据孤岛、完成多机构联合训练建模的可行方案。

数据和机理融合

AI模型的发展是符合简单而美的定律的。从数据出发的建模从数据中总结规律,追求在实践中的应用效果。从机理出发的建模以基本物理规律为出发点进行演绎,追求简洁与美的表达。

一个好的、主流的的模型,通常是高度总结了数据规律并切合机理的,是“优雅”的,因为它触及了问题的本质。就和科学理论一样,往往简洁的,没有太多补丁,而这同时解决了收敛速度问题和泛化问题。

神经网络模型结构发展

神经网络的演进一直沿着模块化+层次化的方向,不断把多个承担相对简单任务的模块组合起来。

神经网络结构通过较低层级模块侦测基本的特征,并在较高层级侦测更高阶的特征,无论是多层前馈网络,还是卷积神经网络,都体现了这种模块性(近年Hinton提出的“胶囊”(capsule)网络就是进一步模块化发展)。因为我们处理的问题(图像、语音、文字)往往都有天然的模块性,学习网络的模块性若匹配了问题本身内在的模块性,就能取得较好的效果。

层次化并不仅仅是网络的拓扑叠加,更重要的是学习算法的升级,仅仅简单地加深层次可能会导致BP网络的梯度消失等问题。

多学派方法融合发展

通过多学派方法交融发展,得以互补算法之间的优势和弱点。如 1)贝叶斯派与神经网络融合,Neil Lawrence组的Deep Gaussian process, 用简单的概率分布替换神经网络层。2)符号主义、集成学习与神经网络的融合,周志华老师的深度随机森林。3) 符号主义与神经网络的融合:将知识库(KG)融入进神经网络,如GNN、知识图谱表示学习。4) 神经网络与强化学习的融合,如谷歌基于DNN+强化学习实现的Alpha Go 让AI的复杂任务表现逼近人类。

基于大规模无(自)监督预训练发展

If intelligence is a cake, the bulk of the cake is unsupervised learning, the icing on the cake is supervised learning, and the cherry on the cake is reinforcement learning (RL) -- Yann Lecun

监督学习需要足够的带标签数据,然而人工标注大量数据既耗时又费力,在一些领域(如医学领域)上几乎不太可能获得足量的标注数据。通过大规模无(自)监督预训练方法利用现实中大量的无标签数据是一个研究的热点,如GPT-3的出现激发了对大规模自监督预训练方法继续开展探索和研究。未来,基于大规模图像、语音、视频等多模态数据的跨语言的自监督预训练模型将进一步发展,并不断提升模型的认知、推理能力。

基于因果学习方法发展

当前人工智能模型大多关注于数据特征间相关性,而相关性与更为本源的因果关系并不等价,可能导致预测结果的偏差,对抗攻击的能力不佳,且模型往往缺乏可解释性。另外,模型需要独立同分布(i.i.d.)假设(现实很多情况,i.i.d.的假设是不成立的),若测试数据与训练数据来自不同的分布,统计学习模型往往效果不佳,而因果推断所研究的正是这样的情形:如何学习一个可以在不同分布下工作、蕴含因果机制的因果模型(Causal Model),并使用因果模型进行干预或反事实推断。

可解释性AI (XAI)发展

可解释的人工智能有可能成为未来机器学习的核心,随着模型变得越来越复杂,确定简单的、可解释的规则就会变得越来越困难。一个可以解释的AI(Explainable AI, XAI)意味着AI运作的透明,便于人类对于对AI监督及接纳,以保证算法的公平性、安全性及隐私性。

图片后记

随着数据、算力及算法取得不断的突破,人工智能可能进入一个永恒的春天。本文主要从技术角度看待AI趋势是比较片面的,虽然技术是“高大上”的第一生产力,有着自身的发展规律,但不可忽视的是技术是为需求市场所服务的。技术结合稳定的市场需求,才是技术发展的实际导向。

*博客内容为网友个人发布,仅代表博主个人观点,如有侵权请联系工作人员删除。